L'intelligence artificielle agentique s'impose comme l'une des tendances technologiques les plus prometteuses de 2025. Mais cette révolution soulève des questions juridiques et sécuritaires fondamentales que le droit doit anticiper.

Une révolution silencieuse en marche

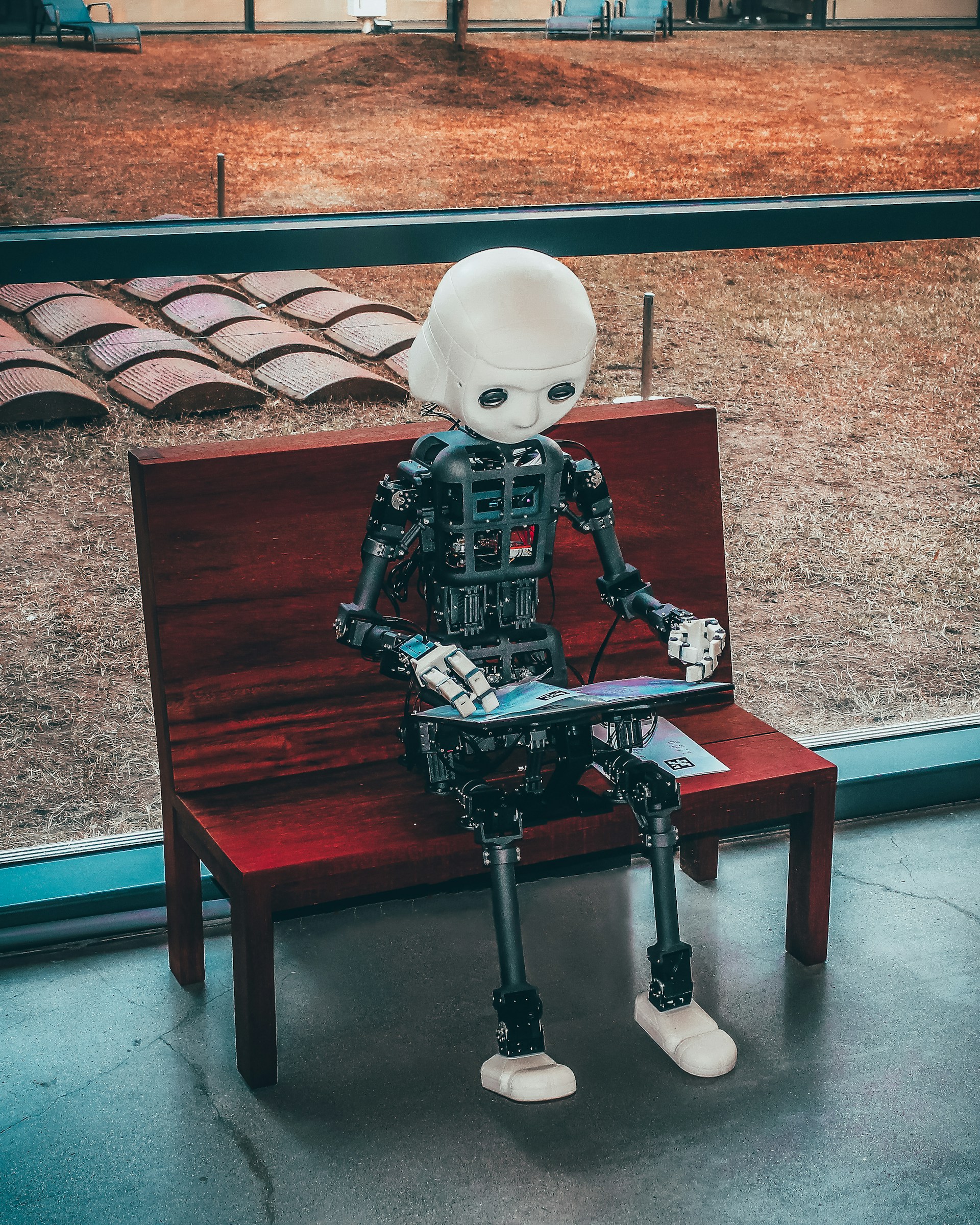

L'été 2025 marque un tournant dans l'évolution de l'intelligence artificielle. Alors que nous nous habituions aux chatbots et aux assistants virtuels, une nouvelle génération d'IA fait son apparition : les agents IA. Ces systèmes autonomes ne se contentent plus de répondre à nos questions, ils agissent pour nous, prennent des décisions et exécutent des tâches complexes sans intervention humaine.

Le lancement récent de Comet par Perplexity illustre parfaitement cette mutation. Ce navigateur révolutionnaire promet de transformer notre rapport au web : fini les onglets multiples et la navigation laborieuse, place à un « deuxième cerveau » capable de mener des recherches autonomes, de comparer des informations et même d'effectuer des achats en ligne. L'utilisateur n'a plus qu'à exprimer son besoin, l'agent se charge du reste.

Parallèlement, le secteur de la cybersécurité s'empare de ces technologies pour révolutionner ses pratiques. Les « Cybersecurity Digital Twins » créent des simulations virtuelles complètes de l'environnement IT d'une entreprise, permettant d'anticiper les cyberattaques et de tester les défenses en temps réel. Cette approche proactive marque une rupture avec les méthodes traditionnelles de sécurité informatique.

L'alerte de Signal : quand la sécurité devient un paradoxe

Mais cette révolution technologique soulève des inquiétudes légitimes. Lors du sommet « AI for Good » à Genève, Meredith Whittaker, présidente de Signal, a lancé un avertissement sans équivoque : les agents IA représentent une menace existentielle pour la confidentialité numérique.

Son analyse est implacable : pour fonctionner, ces agents nécessitent un accès « root » aux systèmes, comparable à celui d'un administrateur système. Ils doivent pouvoir interagir avec tous les services de l'appareil – calendriers, applications bancaires, messageries – brisant ainsi les barrières de sécurité traditionnelles. Whittaker compare cette situation à « une rupture de la barrière entre le cerveau et le sang », métaphore saisissante pour illustrer le danger d'une fusion entre des couches système qui devraient rester étanches.

Cette analyse révèle un paradoxe troublant : alors que l'IA promet de renforcer la cybersécurité d'un côté, elle pourrait simultanément la fragiliser de l'autre. Les mêmes technologies qui permettent de créer des systèmes de défense ultra-sophistiqués créent aussi de nouvelles vulnérabilités.

Les enjeux juridiques d'une technologie disruptive

Cette tension technologique soulève des questions juridiques inédites que le droit doit urgemment appréhender.

La responsabilité civile à l'épreuve de l'autonomie

Quand un agent IA effectue un achat non désiré, réserve un mauvais restaurant ou divulgue des informations confidentielles, qui est responsable ? L'utilisateur qui a délégué la tâche ? L'éditeur du logiciel ? Le fournisseur de l'IA sous-jacente ? Le cadre juridique actuel, pensé pour des outils passifs, se révèle inadapté à ces nouvelles formes d'autonomie technologique.

Protection des données personnelles : un défi systémique

Les agents IA traitent par nature des volumes considérables de données personnelles. Leur fonctionnement même implique une surveillance continue des activités numériques de l'utilisateur. Comment concilier cette réalité avec les principes du RGPD ? La notion de « minimisation des données » devient-elle caduque face à des systèmes qui ont besoin d'un accès global pour fonctionner ?

Sécurité et souveraineté numérique

L'alerte de Signal résonne particulièrement dans un contexte où gouvernements, entreprises et organisations dépendent de plus en plus de la sécurité numérique. Si les agents IA compromettent les fondements de la confidentialité digitale, quelles sont les implications pour la souveraineté numérique des États et la protection des secrets industriels ?

Vers quelles applications futures ?

L'imagination des développeurs ne semble pas avoir de limites quant aux applications futures de l'IA agentique.

L'assistant juridique autonome

Imaginez un agent IA capable de surveiller en permanence l'évolution législative et réglementaire, d'analyser l'impact des nouvelles lois sur les contrats d'une entreprise, et de proposer automatiquement des amendements. Cette perspective, séduisante pour l'efficacité, soulève des questions sur la responsabilité déontologique et l'exercice du droit.

La négociation automatisée

Des agents IA pourraient bientôt négocier des contrats entre eux, analysant en temps réel les conditions du marché et les contraintes légales. Cette automatisation pourrait révolutionner le monde des affaires, mais elle interroge sur la validité juridique de contrats conclus sans intervention humaine directe.

La surveillance comportementale prédictive

Les agents de sécurité pourraient analyser les comportements numériques pour prédire et prévenir les violations de sécurité. Cette capacité prédictive, déjà utilisée dans certains systèmes de cybersécurité, pourrait s'étendre à la surveillance des employés ou même des citoyens.

Construire un cadre juridique adapté

Face à ces défis, le droit doit évoluer rapidement pour encadrer cette révolution technologique.

Transparence et auditabilité

Les agents IA doivent être conçus avec des mécanismes de transparence permettant de comprendre leurs décisions et d'en assurer la traçabilité. Cette exigence pourrait devenir une obligation légale, à l'instar des dispositions sur l'explicabilité des algorithmes.

Droit à la déconnexion agentique

Les utilisateurs doivent conserver le droit de désactiver ou de limiter l'action des agents IA. Cette notion de « droit à la déconnexion agentique » pourrait s'imposer comme un principe fondamental de protection des consommateurs.

Certification et standards de sécurité

Le développement d'agents IA pourrait être soumis à des procédures de certification obligatoires, garantissant le respect de standards de sécurité et de protection des données. Cette approche, déjà adoptée dans certains secteurs critiques, pourrait s'étendre à l'ensemble des applications agentiques.

Conclusion : faire du droit un allié de l'innovation

L'IA agentique représente indéniablement une révolution technologique majeure, porteuse d'opportunités extraordinaires mais aussi de risques inédits. La tension entre les promesses d'efficacité et les exigences de sécurité n'est pas insurmontable, mais elle nécessite une approche juridique proactive et nuancée.

Le défi pour les juristes et les législateurs est de créer un cadre qui permette l'innovation tout en protégeant les droits fondamentaux. Il ne s'agit pas d'entraver le progrès technologique, mais de l'accompagner avec les garde-fous nécessaires.

L'avenir de l'IA agentique se jouera autant dans les tribunaux et les parlements que dans les laboratoires de recherche. Car comme toujours en droit numérique, la technologie pose les questions, mais seul le droit peut apporter les réponses durables.

Dans ce contexte d'évolution rapide, l'accompagnement juridique devient plus que jamais stratégique. Les entreprises qui sauront anticiper ces enjeux et construire des solutions conformes aux exigences légales prendront une longueur d'avance décisive sur leurs concurrents.